Los Consejos de Administración, ante el reto de gobernar una IA ética

Esade Center for Corporate Governance e IBM publican la “Guía de Consejeros para una IA ética”_

La Inteligencia Artificial —y especialmente la generativa— ha dejado de ser un asunto operativo para convertirse en un tema de gobierno corporativo: redefine prioridades estratégicas, eleva riesgos reputacionales y regulatorios, y exige que los Consejos de Administración incorporen nuevos criterios de supervisión, transparencia y rendición de cuentas. En este contexto, el Esade Center for Corporate Governance e IBM han elaborado la “Guía de Consejeros para una IA ética”, una hoja de ruta para ayudar a los Consejos a impulsar innovación con control, alinear la IA con los valores corporativos y anticipar el nuevo marco normativo europeo y español.

La IA en la “sala de máquinas” del Consejo

La Guía parte de una constatación: la disrupción tecnológica ya ocupa un lugar recurrente en la agenda del Consejo y, en los próximos años, la IA generativa se consolidará entre los asuntos más relevantes, solo por detrás de la ciberseguridad en los análisis de agenda hacia 2030. Además, el documento subraya que el impacto de la IA no se limita a la eficiencia operativa, sino que condiciona decisiones críticas de inversión, innovación, talento y relación con grupos de interés.

La presencia de perfiles expertos en tecnología en los Consejos sigue siendo reducida

La publicación alerta de una brecha: la presencia de perfiles expertos en tecnología en los Consejos sigue siendo reducida (en torno al 8% en ciertas muestras globales citadas), mientras que la responsabilidad fiduciaria evoluciona. En la era de la IA, estar “debidamente informado” implica comprender riesgos (sesgos, privacidad, ciberseguridad, dependencia de terceros) y formular preguntas incisivas sobre transparencia y planes de contingencia.

Riesgos clave: cuando la IA escala, también lo hacen sus efectos y responsabilidades

La Guía subraya que el principal desafío para los Consejos no es decidir si usar IA, sino cómo hacerlo sin abrir frentes de riesgo difíciles de controlar. En primer lugar, advierte del sesgo y la discriminación algorítmica: dado que los datos son muy importantes y los modelos se entrenan con ellos, si contienen sesgos inherentes la IA puede perpetuarlos e incluso amplificarlos, generando resultados discriminatorios —por ejemplo, en contratación, concesión de crédito y administración de justicia—, con impacto social y potencial responsabilidad legal y reputacional. A ello se suma la falta de transparencia y explicabilidad, el conocido problema de la “caja negra”: cuando no se entiende cómo se ha desarrollado y entrenado el modelo o cómo se ha llegado a una decisión concreta, se resiente la confianza y se dificulta la rendición de cuentas. Y, precisamente por eso, pone el foco en la responsabilidad difuminada y la falta de rendición de cuentas, subrayando la necesidad de establecer líneas claras de responsabilidad sobre el desarrollo y el uso de la IA para evitar incertidumbre y mejorar la supervisión.

La Guía subraya que el principal desafío para los Consejos no es decidir si usar IA, sino cómo hacerlo sin abrir frentes de riesgo difíciles de controlar. En primer lugar, advierte del sesgo y la discriminación algorítmica: dado que los datos son muy importantes y los modelos se entrenan con ellos, si contienen sesgos inherentes la IA puede perpetuarlos e incluso amplificarlos, generando resultados discriminatorios —por ejemplo, en contratación, concesión de crédito y administración de justicia—, con impacto social y potencial responsabilidad legal y reputacional. A ello se suma la falta de transparencia y explicabilidad, el conocido problema de la “caja negra”: cuando no se entiende cómo se ha desarrollado y entrenado el modelo o cómo se ha llegado a una decisión concreta, se resiente la confianza y se dificulta la rendición de cuentas. Y, precisamente por eso, pone el foco en la responsabilidad difuminada y la falta de rendición de cuentas, subrayando la necesidad de establecer líneas claras de responsabilidad sobre el desarrollo y el uso de la IA para evitar incertidumbre y mejorar la supervisión.

El desafío para los Consejos radica en cómo usa la IA sin abrir frentes de riesgo difíciles de controlar

Además, el documento recoge los riesgos operacionales y de cumplimiento asociados con la implementación de la IA, incluyendo el riesgo de inversiones que no logran los resultados esperados, el incumplimiento regulatorio por usos inadecuados, así como la dependencia de proveedores externos y la posible pérdida de habilidades internas; todos ellos desafíos que exigen una gestión cuidadosa. En paralelo, destaca la privacidad, seguridad de los datos y data poisoning: el uso intensivo de datos eleva el riesgo de filtraciones y de uso indebido de información sensible, y obliga a reforzar medidas de seguridad y cumplimiento (por ejemplo, GDPR) e impedir la manipulación maliciosa de datos. Por último, alerta del uso indebido y las consecuencias no deseadas de la IA, desde la creación de deepfakes (falsificación digital) y la difusión de desinformación hasta impactos no previstos en empleo y sociedad, que pueden erosionar la confianza pública si no se anticipan y controlan.

No hay gobierno sin visibilidad

Uno de los mensajes fuerza del documento es que no se puede gobernar lo que no se ve, por eso se enfatiza la necesidad de mantener un inventario completo de sistemas de IA/ML (adquiridos o desarrollados), con metadatos (propósito, origen de datos, responsables, auditorías), y en establecer protocolos de auditoría continuada, incluidos mecanismos contractuales para terceros.

Para pasar de la teoría a la práctica, la Guía propone una visión holística del gobierno de IA en seis frentes:

-

Principios, políticas y procesos alineados con valores y regulación.

-

Estructura organizativa (roles, responsabilidades, modelos centralizados/federados, comité de ética).

-

Evaluación y auditoría periódicas, observabilidad y automatización del control.

-

Tecnología e ingeniería (IA responsable “by design”, seguridad y privacidad integradas).

-

Modelo operativo y adopción (playbook, integración con gobierno del dato y gestión de riesgos).

-

Sensibilización y formación en toda la organización, incluido el propio Consejo.

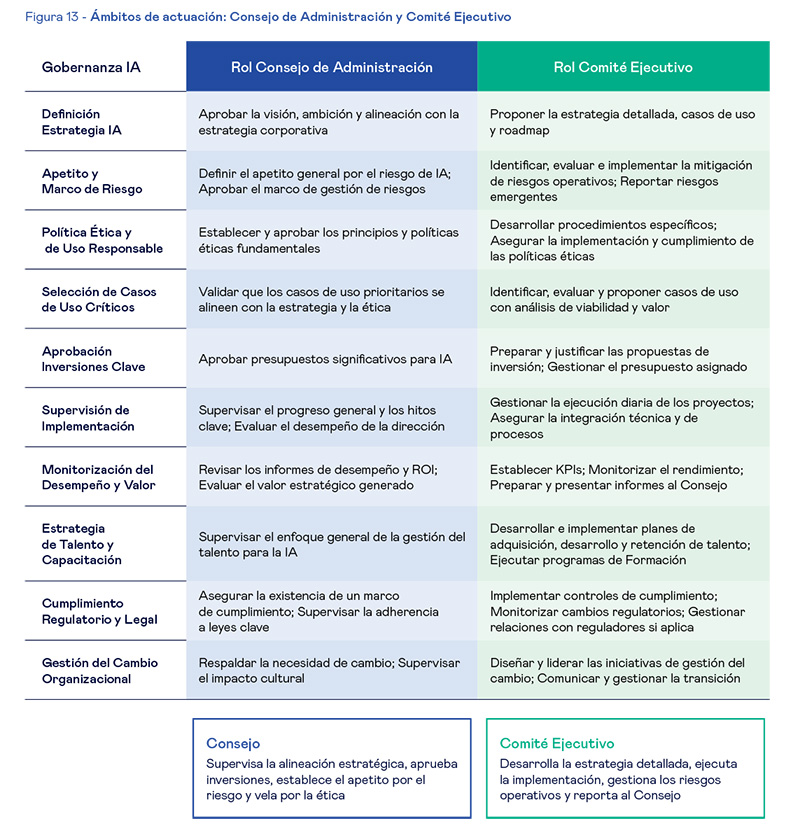

Con el fin de aterrizar la gobernanza de una IA ética, la publicación delimita con claridad quién decide qué: qué responsabilidades son indelegables del Consejo y cuáles corresponden al Comité Ejecutivo para asegurar una implantación rigurosa, medible y alineada con el propósito y el apetito de riesgo de la organización.

Las implicaciones normativas en el ámbito europeo y español es otro de los temas abordados, así como el desarrollo de un marco de retorno específico para medir el éxito de las iniciativas de ética y gobierno de la IA. Un éxito que no puede medirse por “tener políticas”, sino por el grado de integración real en la estrategia y los flujos de trabajo, porque –tal y como concluye el documento–: "El gobierno responsable de la IA representa un imperativo estratégico que, bien ejecutado, impulsa el crecimiento sostenible y la creación de valor a largo plazo para todos los stakeholders".

Publicado en enero de 2026.

Últimos artículos